Em aplicações reais, as redes neurais se saem particularmente bem nas seguintes tarefas:

- aproximação de funções;

- previsão de séries temporais;

- classificações;

- reconhecimento de padrões.

CTRNN[editar | editar código-fonte]

Outros tipos de redes neurais, em particular redes neurais recorrentes de tempo contínuo (CTRNN), são usadas em conjunto com algoritmos genéticos para produzir controladores robóticos. O genoma é então constituído dos parâmetros de rede e a aptidão de uma rede é a adequação do comportamento exibido pelo robô controlado (ou freqüentemente por uma simulação desse comportamento).

Tipos de redes neurais[editar | editar código-fonte]

O exemplo mais antigo de redes neurais são as redes perceptron, com uma camada de nós de saída, conectados às entradas por conjuntos de pesos. Essa topologia pode ser considerada a forma mais simples de rede em avanço. A soma do produtos dos pesos pelas entradas é calculada por cada nó de saída e, se o valor calculado ultrapassar um certo limiar (geralmente 0), o neurônio dispara e ajusta a saída para o valor 1; se o valor calculado é menor que o limiar, a saída é ajustada para o valor -1. Neurônios com esse comportamento são chamados de neurônios de McCulloch-Pitts ou neurônios com limiar. Ao mesmo tempo, um algoritmo de aprendizado calcula a diferença entre a saída calculada e os dados de entrada e usa o valor da diferença para ajustar os pesos da rede.

Perceptron com uma camada[editar | editar código-fonte]

Perceptrons podem ser treinados por um algoritmo de aprendizagem simples, chamado geralmente de regra-delta. Esse algoritmo calcula os erros entre a saída dos dados calculados e a saída desejada e utiliza isso para ajustar os pesos, assim executando um formulário da descida do gradiente.

Os perceptrons de uma camada são capazes de aprender somente sobre problemas linearmente separáveis (que podem ser separados por uma reta em um hiperplano). Em 1969, na famosa monografiaPerceptrons por Marvin Minsky e por Seymour Papert, mostrou-se que era impossível para uma única rede do perceptron da camada aprender uma função de XOR. Conjecturou-se (incorretamente) que um resultado similar penderia para uma rede multicamadas do perceptron. Embora uma única unidade do ponto inicial fosse completamente limitada em seu poder computacional, mostrou-se que as redes de unidades paralelas do ponto inicial podem aproximar toda a função contínua de um intervalo compacto dos números reais no intervalo [- 1, 1 ].

Perceptron multicamadas[editar | editar código-fonte]

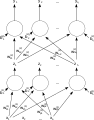

Esta classe de rede consiste de múltiplas camadas de unidades computacionais, geralmente interconectadas em uma forma de alimentação avante. Isso quer dizer que cada neurônio em uma camada tem conexões diretas a neurônios da próxima camada. Em muitas aplicações, as unidades dessas redes utilizam uma função sigmóide (em forma de S) como a função de ativação.

O teorema de aproximação universal dita que toda função contínua que mapeia intervalos de números reais de entrada a algum intervalo de números reais de saída pode ser arbitrariamente aproximada com precisão por um perceptron multicamadas com somente uma camada oculta. Esse resultado só é válido para classes restritas de funções de ativação, por exemplo, funções sigmóides.

As redes multicamadas podem usar um grande número de técnicas de aprendizado, sendo que a mais popular é a propagação reversa. Nesse caso, os valores de saída são comparados com a resposta correta para computar o valor de alguma função de erro pré-definida. Por alguma técnica, o erro é então alimentado de volta na rede. Usando essa informação, o algoritmo ajusta os pesos de cada conexão para reduzir o valor da função de erro.

Redes ARTs[editar | editar código-fonte]

ART são as siglas em inglês de Teoria da Ressonância Adaptativa (Adaptive Resonance Theory), desenvolvida inicialmente por Stephen Grossberg, em 1976, e em publicações posteriores em parceria com Gail Carpenter (1986/87).

As redes neurais artificiais ART são redes que não precisam da exposição prévia de qualquer número de elementos do conjunto de dados para o seu treinamento. A principal característica dessa família de arquiteturas é a sua capacidade para formar agrupamentos (clusters), que nos permite identificar padrões desconhecidos.[15] Existem três modelos de redes ARTs:

ART1: é capaz de aprender a categorizar padrões de entrada binários apresentados em ordem arbitrária.

ART2: pode aprender a categorizar padrões de entrada analógicos ou binários.

ART3 (ARTMAP): pode realizar uma busca paralela, ou teste de hipóteses, em códigos com reconhecimento distribuído.

Aplicação[editar | editar código-fonte]

Reconhecimento Automático de Alvos; Reconhecimento de Caracteres; Robótica; Diagnóstico Médico; Sensoriamento Remoto; Processamento de Voz;

Aprendizado[editar | editar código-fonte]

O algoritmo de aprendizado da rede ART 1 não é supervisionado e pode ser ativa a qualquer momento, permitindo que a rede aprenda novos padrões continuamente.

Existem 2 tipos de aprendizado na rede ART 1, o aprendizado rápido e o lento.

O processo de aprendizado da rede envolve 3 fases como: reconhecimento, comparação e busca.

Rede Hopfield[editar | editar código-fonte]

Em 1982 houve uma nova evolução nos trabalhos das redes neurais iniciado por John Hopfield,[16] nascido em 15 de julho de 1933 é um americano Cientista mais conhecido pela invenção de uma rede neural associativa, conhecida como a Rede de Hopfield. John Hopfield publicou dois artigos que influenciaram vários pesquisadores, chamando a atenção para as propriedades associativas de uma classe de Redes Neurais. A análise é baseada na definição de “energia” da rede. É uma prova de que a rede opera minimizando esta energia quando evolui para padrões estáveis de operação.

Definições Iniciais[editar | editar código-fonte]

É uma memória auto-associativa. Suas entradas são valores binários.[17] Possui uma natureza de operação assíncrona, isto é a cada instante de tempo, cada neurônio tem seu estado de ativação “avaliado” de maneira independente dos outros neurônios.

Memória associativa[editar | editar código-fonte]

É um conceito intuitivo,[18] onde parece ser uma das funções primárias do cérebro, e facilmente associamos objetos, imagens e sensações a eventos com a rede Hopfield, serve para reconstituir padrões corrompidos ou incompletos, um exemplo é uma pessoa que normalmente não usa óculos escuros, com eles, mesmo assim é reconhecido, assim recuperando informações pelo conteúdo.

A rede de Hopfield pode ser vista como uma memória associativa, ou uma memória endereçável por conteúdo, cuja principal função é restaurar um padrão (item de memória ) armazenado em resposta à apresentação de uma versão incompleta ou ruidosa deste padrão.

Aplicação[editar | editar código-fonte]

A rede Hopfield foi aplicada em várias áreas, tendo um campo de utilização muito grande, umas delas foi a Identificação de alvos militares B-52, Boeing 747 e Space Shuttle, Autentição de usuários, exploração de petróleo e determinação e litologia, Predição no Mercado Financeiro, Reconhecimentos de Faces e Controle de Navegação Autônoma de Veículos ALVINN at CMU.[19]

As Redes Neurais vem sendo usadas com sucesso para determinar o rating de crédito de empresas. Como nos mostra a pesquisa de Zekic-Susac et al. 2004 que compara a eficácia de diferentes formas de determinação do crédito as Redes Neurais com Backpropagation apresentam os melhores resultados, inclusive mostrando dados e relações a respeito das empresas estudadas que não apareceram de outras formas.

Um bom exemplo de uso de Redes Neurais para a determinação de rating de crédito para empresas é visto no artigo de Carling Et al. 2002 em que é feito um estudo do rating de debentures no mercado asiático. Eles usam o modelo de backpropagation e constroem a análise usando uma série de indicadores usados pelos especialistas em análise de crédito.

Estrutura[editar | editar código-fonte]

As unidades em redes de Hopfield são unidades binárias do ponto inicial, isto é, as unidades fazem exame somente em dois valores diferentes para seus estados e o valor é determinado perto se ou não a entrada das unidades excede seu ponto inicial. As redes de Hopfield podem um ou outro ter as unidades que fazem exame em valores de 1 ou de -1, ou as unidades que fazem exame em valores de 1 ou de 0.

Treinamento[editar | editar código-fonte]

Treinar uma rede de Hopfield envolve abaixar a energia dos estados que a rede se “recorde”. Isto permite que a rede sirva como um sistema da memória endereçável satisfeita, aquele é dizer, a rede convergirá a um estado “recordado” se for dado somente a parte do estado. A rede pode ser usada recuperar de uma entrada distorcida o estado treinado que é o mais similar a essa entrada. Isto é chamado memória associativa porque recupera memórias na base da similaridade. Por exemplo, se nós treinarmos uma rede de Hopfield com cinco unidades de modo que o estado (1, 0, 1, 0, 1)[20] seja um mínimo da energia, e nós damos à rede o estado (1, 0, 0, 0, 1) que convergirá (1, 0, 1, 0, 1). Assim, a rede está treinada corretamente quando a energia dos estados que a rede deve recordar é mínimos locais. O treinamento é de suma importância para o desempenho eficaz do mesmo

Memoria Associativa[editar | editar código-fonte]

Memória associativa é um meio de armazenamento e recuperação da informação por associação com outras informações.

Um dispositivo de armazenamento é chamado memória associativa, se você pode recuperar informações a partir do conhecimento parcial do seu conteúdo, sem saber seu local de armazenamento. Às vezes também chamado de memória de conteúdo não endereçável.

Os Computadores tradicionais não usam este direcionamento, se baseiam no conhecimento exato da direção (endereço) da memória em que se encontra a informacão.

No entanto, o cérebro humano não funciona assim. Se nos lembrarmos do nome de uma pessoa, não seria útil determinar qual foi o nome de número 3.274 que aprendemos. Seria mais útil saber que seu nome começa e termina com 'N' e é um famoso cientista Inglês. Com essa informação, quase certamente se lembraria com sucesso de "Newton".

Memórias associativas são uma das mais importantes redes neurais com uma vasta gama de aplicações em áreas como o acesso ao conteúdo de memória, reconhecimento de padrões e controle inteligente.

Uma memória associativa pode armazenar e recuperar informações quando necessário, ou seja, uma rede realimenta a saída que é usada repetidamente como uma nova entrada até que o processo termine. Você pode obter essas informações com base no conhecimento da parte dela (chave). O padrão de chave pode ser uma versão ruidosa de um padrão de memorização, ou seja, que difere em alguns componentes. A memória humana é uma reminiscência de uma pessoa, mesmo se você se veste diferente ou usa óculos.

Os primeiros modelos de memórias associativas baseadas na Morfologia Matemática, referidos como Memórias Associativas Morfológicas (MAMs), foram introduzidas por Ritter e Sussner em meados dos anos 1990[21][22]. Especificamente, os neurônios das MAMs efetuam generalizações das operações da abordagem umbra da morfologia matemática em tons de cinza. Em termos gerais, a principal diferença entre os modelos clássicos de memórias associativas e os modelos morfológicos está em utilizar as operações baseadas em reticulados no lugar das operações usuais de multiplicação de matrizes[22].

Propriedades Teóricas[editar | editar código-fonte]

Capacidade Computacional[editar | editar código-fonte]

O Perceptron multicamadas é um aproximador universal de funções, como provado pelo teorema de Cybenko. No entanto, a prova não é construtiva sobre o número de neurônios requeridos ou as configurações dos valores dos pesos necessárias. O trabalho de Hava Siegelmann e Eduardo D. Sontag forneceu uma prova que uma arquitetura recorrente específica com valores lógicos dos pesos tem o todo o poder de uma Máquina de Turing[23] usando um número finito de neurônios e conexões lineares padrões. Eles mostram também que o uso de valores ilógicos para os pesos resulta em uma máquina com capacidade de uma "super" Máquina de Turing.

Capacidade[editar | editar código-fonte]

Modelos de RNAs tem uma propriedade chamada capacidade, a qual grosseiramente corresponde a sua habilidade de modelar qualquer função determinada. Isso está relacionado com a quantidade de informação que pode ser armazenada na rede e a noção de complexidade.

Convergência[editar | editar código-fonte]

No geral nada pode ser dito sobre convergência vendo que ela depende de alguns de fatores. Primeiramente, podem existir mínimos locais e isto depende da função de custo e do modelo. Em segundo lugar, o método de otimização usado pode não garantir a convergência quando estiver muito longe do mínimo local. Em terceiro lugar, para uma quantidade de dados ou parâmetros muito grande, alguns métodos se tornam impraticáveis. No geral, foi descoberto que garantias teóricas sobre a convergência são guias pouco confiáveis para aplicação prática.

Generalização e Estatísticas[editar | editar código-fonte]

Em aplicações nas quais o objetivo é criar um sistema que generalize bem em exemplos cegos, surge o problema de excesso de treinamento. Isso acontece em sistemas complicados ou excessivamente específicos, quando a capacidade da rede excede significantemente a necessidade dos parâmetros. Há duas escolas de pensamento para evitar este problema: A primeira é o uso da validação cruzada e técnicas similares para checar a presença de excesso de treinamento e selecionar otimamente hiperparâmetros a fim de minimizar o erro de generalização. A segunda é usar alguma forma de regularização. Este conceito surge naturalmente em um quadro probabilístico (Baysiano), no qual a regularização pode ser feita selecionando uma maior probabilidade anterior em relação a modelos mais simples; mas também no aprendizado estatístico teórico, no qual o objetivo é minimizar até duas quantidades: o 'risco empírico' e o 'risco estrutural', o qual corresponde ao erro sobre o conjunto de treinamento e o erro previsto em dados cegos. Redes neurais supervisionadas que usam uma função de custo de erro médio quadrático podem usar métodos estatísticos formais para determinar a confiança do modelo treinado. O erro médio quadrático em um conjunto de validação pode ser usado como uma estimativa para variação. Este valor pode então ser usado para calcular o intervalo de confiança de uma saída na rede neural, assumindo a distribuição normal. A análise da confiança feita desta maneira é estatisticamente válida enquanto a distribuição probabilística da saída se mantiver a mesma e a rede neural não modificada. Assumindo a função de ativação softmax na camada de saída da rede neural para variáveis categóricas alvos, a saída pode ser interpretada como probabilidades posteriores. Isso é muito útil na classificação, pois dá uma medida de certeza sobre as classificações.

função de ativação softmax:

Redes Neurais e Neurociência[editar | editar código-fonte]

Neurociência computacional e teórica é o campo preocupado com a análise teórica e a modelagem computacional do sistema nervoso biológico. Como sistemas neurais estão intimamente relacionados com processos cognitivos e comportamentais, eles também estão fortemente ligados a modelagem cognitiva e comportamental.

O objetivo do campo é criar modelos de sistemas neurais biológicos para entender o funcionamento de sistemas biológicos reais. Para chegar a esse entendimento, neurocientistas tentam fazer uma ligação entre processos biológicos observados (dados), mecanismos biologicamente plausíveis de processamento e aprendizado neural (modelos de redes neurais biológicas) e teoria (aprendizado estatístico e teoria da informação).

Tipos de modelos[editar | editar código-fonte]

Muitos modelos são usados neste campo, cada um definido em um nível diferente de abstração e tentando modelar diferentes aspectos de sistemas neurais. Eles vão de modelos de comportamento de curto prazo de neurônios individuais, passando por modelos de como as dinâmicas de circuitos neurais surgem de interações entre neurônios individuais, até modelos de como comportamentos podem surgir de módulos neurais abstratos que representam subsistemas completos. Estes incluem modelos de plasticidade de curto e longo prazo de sistemas neurais e sua relação com o aprendizado e a memória, de um neurônio individual até o nível de um sistema.

Galeria[editar | editar código-fonte]

Referências

- ↑ BARONE, Dante Augusto Couto: "Sociedades Artificiais: a nova fronteira da inteligencia nas máquinas", (2003), Porto Alegre: Bookman

- ↑ HAYKIN, Simon. Redes neurais: princípios e prática. trad. Paulo Martins Engel. - 2.ed. - Porto Alegre: Bookman, 2001.

- ↑ Hebb, D.O.. Brain Mechanisms and Learning. London: J. F. Delafresnaye (Ed.), 1961.

- ↑ HAYKIN, Simon. Redes neurais: princípios e prática. trad. Paulo Martins Engel. - 2.ed. - Porto Alegre: Bookman, 2001.

- ↑ a b c d MÁSSON, Egill; WANG, Yih-Jeou. Introduction to Computation and Learning in Artificial Neural Networks. European Journal of Operational Research, North-Holand , 47, 1990.

- ↑ a b c Braga, Antônio de Pádua; Carvalho, André P. L. Ferreira; Ludermir, Teresa Bernarda, "Redes Neurais Artificiais: Teoria e Aplicações" (2000), Rio de Janeiro: LTC.

- ↑ HAYKIN, Simon. Redes neurais: princípios e prática. trad. Paulo Martins Engel. - 2.ed. - Porto Alegre: Bookman, 2001.

- ↑ a b WASSERMAN, Philip D. Neural Computing : Theory and Practice. New York : Van Nostrand Reinhold, 1989.

- ↑ HAYKIN, Simon. Redes neurais: princípios e prática. trad. Paulo Martins Engel. - 2.ed. - Porto Alegre: Bookman, 2001.

- ↑ REZENDE, Solange Oliveira. Sistemas Inteligentes:fundamentos e aplicações, 2003, Barueri,SP:Manole

- ↑ ZSOLT L KOVACS, REDES NEURAIS ARTIFICIAIS: FUNDAMENTOS E APLICAÇOES(Ed.4), 2006.

- ↑ Bispo, CM (1995) Redes Neurais para Reconhecimento de Padrões, Oxford: Oxford University Press. ISBN 0-19-853849-9 (encadernado) ou ISBN 0-19-853864-2

- ↑ Gurney, K. (1997) Uma Introdução à Redes Neurais London: Routledge. ISBN 1-85728-673-1 capa dura () ou ISBN 1-85728-503-4

- ↑ Hertz, J., Palmer, RG, Krogh. AS (1990) Introdução à teoria da computação neural, Perseus Books

- ↑ BRAGA, Antonio de Padua; LUDERMIR, Teresa Bernarda: "REDES NEURAIS ARTIFICIAIS: Teoria e aplicações", (2000), Rio de Janeiro: LTC

- ↑ ANDERSON, J.A. An Introduction To Neural Networks- Bradford Book, 1995.

- ↑ [1]

- ↑ WASSERMAN, P. Neural Computing Theory and Practice. Van Nostrand Rheinhold, New York, 1989.

- ↑ Braga, Ludermir e Carvalho. Redes Neurais Artificiais. LTC.

- ↑ Capítulo 13 O modelo de Hopfield de Redes Neural - uma introdução sistemática por Raul Rojas (ISBN 978-3540605058)

- ↑ Ritter, G.X.; P. (August 1996). «An introduction to morphological neural networks». Proceedings of the 13th International Conference on Pattern Recognition, 1996. 4: 709-717 vol.4. doi:10.1109/ICPR.1996.547657Verifique data em:

|data=(ajuda) - ↑ a b Ritter, G.X.; P. (March 1998). «Morphological associative memories». IEEE Transactions on Neural Networks. 9 (2): 281-293. doi:10.1109/72.661123. ISSN 1045-9227 Verifique data em:

|data=(ajuda) - ↑ Siegelmann, H.T.; Sontag, E.D. (1991). «Turing computability with neural nets» (PDF). Appl. Math. Lett. 4 (6): 77–80. doi:10.1016/0893-9659(91)90080-F

Ver também[editar | editar código-fonte]

- Redes neurais biológicas

- Inteligência artificial

- FAN (rede neural)

- Neurociência computacional

- Computação Bioinspirada

Nenhum comentário:

Postar um comentário